Modelli AI

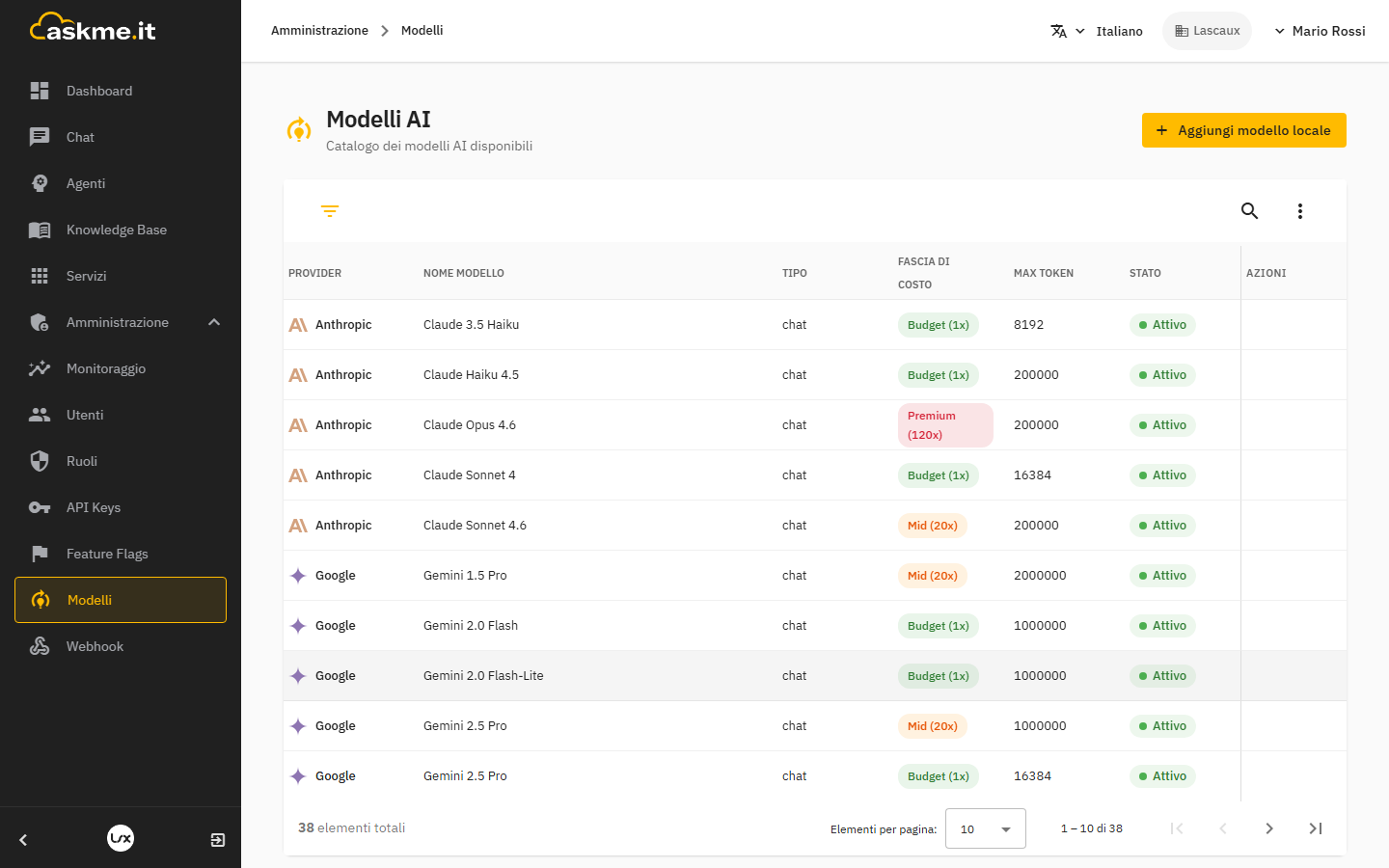

La sezione Modelli AI mostra il catalogo dei modelli LLM disponibili al tuo tenant: modelli globali condivisi e modelli locali aggiunti dal tenant stesso.

Provider supportati

Askme AI supporta nativamente i seguenti provider:

| Provider | Tipologie modelli | Note |

|---|---|---|

| OpenAI | Chat (GPT-4o, GPT-4.1, ecc.), Embedding (text-embedding-3) | API ufficiale |

| Anthropic | Chat (Claude Sonnet, Claude Haiku) | API ufficiale |

| Mistral | Chat (mistral-small/medium/large) | API ufficiale |

| Chat (Gemini 1.5 Pro/Flash) | API ufficiale | |

| Ollama | Chat ed embedding di qualsiasi modello self-hosted | Endpoint locale o privato |

Modelli globali

I modelli globali (con tenant_id non impostato) sono gestiti centralmente dal team IT di Askme e disponibili a tutti i tenant in sola lettura.

Per ciascun modello la card mostra:

- Nome e provider

- Tipo (chat / embedding)

- Context window e max output tokens

- Capacita': function calling, vision, streaming, reasoning

- Fascia di costo — moltiplicatore crediti (vedi sotto)

Modelli locali (Ollama)

Come tenant administrator puoi aggiungere modelli Ollama locali per sfruttare risorse on-prem o private (utile per dati sensibili o per ridurre i costi).

Aggiungere un modello locale

- Click su Aggiungi modello locale

- Compila:

- Nome modello (deve corrispondere al modello installato sull'istanza Ollama)

- Base URL Ollama — endpoint dell'istanza Ollama del tenant

- API key (opzionale, se l'istanza richiede autenticazione)

- Costi per token input/output (in crediti)

- Capacita': function calling, vision, streaming, reasoning

- Salva

Solo i provider ollama e local sono ammessi come modelli a livello di tenant. I provider commerciali (OpenAI, Anthropic, ecc.) sono gestiti centralmente con chiavi API condivise; per richiedere abilitazioni di nuovi provider o nuovi modelli commerciali contatta il team IT di Askme.

Selezione modello negli agenti

Nel form di un agente (Step 3 — Parametri modello), il dropdown Modello AI principale lista tutti i modelli visibili al tenant:

- Modello chat — utilizzato per generare le risposte

- Modello operazionale — utilizzato per operazioni interne come query rewrite e reranking. La configurazione e' centralizzata: per modificarlo contatta il team IT di Askme

- Modello embedding (configurabile a livello di KB) — utilizzato per la vettorizzazione dei documenti

Vedi Gestione agenti — Step 3 per i dettagli sui parametri.

Fasce di costo

Ogni modello ha una fascia di costo che determina il moltiplicatore di crediti AI consumati per token:

| Fascia | Moltiplicatore | Esempio |

|---|---|---|

| Free | 0× (gratuito) | Modelli Ollama locali |

| Budget | 1× | GPT-4o-mini, Claude Haiku, Mistral Small |

| Mid | 20× | GPT-4o, Claude Sonnet |

| Premium | 120× | Modelli reasoning, modelli flagship |

L'utilizzo dei crediti viene tracciato sulla quota mensile (vedi Monitoraggio — Tab Quote).

Suggerimenti

- Inizia col Mid tier per agenti generalisti — buon compromesso qualita'/costo

- Riserva il Premium per task con reasoning complesso (analisi, classificazioni multilivello)

- Usa modelli Free locali per task ad alto volume e bassa criticita' (es. classificazione embedding interna)

- Verifica le capacita' richieste dall'agente: la vision e il function calling sono gating ai tool MCP

- Tieni d'occhio il context window: agenti con KB grandi e cronologia lunga richiedono almeno 32k token di contesto